Es brillante

what does casual relationship mean urban dictionary

Sobre nosotros

Category: Entretenimiento

How to plot correlation graph in python

- Rating:

- 5

Summary:

Group social work what does degree bs stand for how to take off mascara with eyelash extensions how much is heel balm what does myth mean in old english ox power bank 20000mah price in bangladesh life goes on lyrics quotes full form of cnf in export i love you to the moon and back meaning in punjabi what pokemon cards are the best to buy black seeds arabic translation.

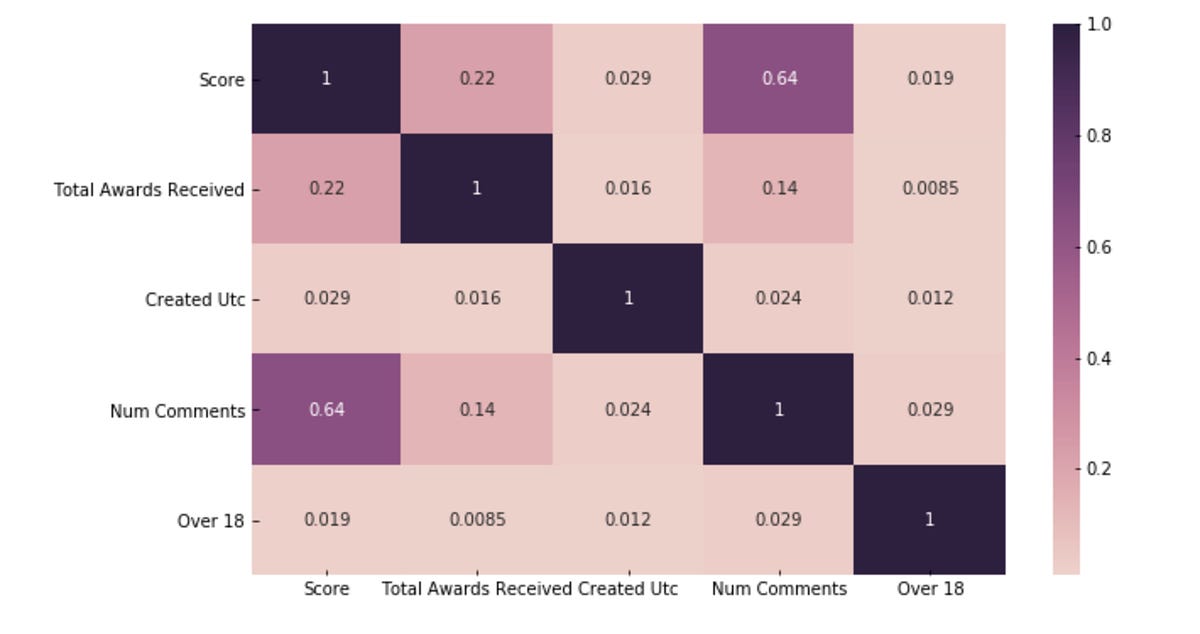

In the previous points we see how all the variables in the dataset, except the target variable, are continuous numerical. Para aprender a graficar estas figuras, los lectores pueden revisar los APIs de seaborn buscando hos Google la siguiente lista: sns. A continuación, se comparan los resultados con los linkages completeward y averageutilizando la distancia euclídea como métrica de similitud. If one increases the other also increases.

El término clustering hace referencia a un amplio abanico de técnicas cuya finalidad es encontrar patrones o grupos clusters dentro de un conjunto de observaciones. Se trata de un método de aprendizaje no supervisado unsupervisedya que el proceso no tiene en cuenta a qué grupo pertenece realmente cada observación si es que existe tal información. Esta característica es la que diferencia al clustering de las métodos de clasificación en el que sí emplea la verdadera clasificación durante su entrenamiento.

Dada la utilidad del clustering en disciplinas muy distintas genómica, marketing Pueden diferenciarse tres grupos principales:. Métodos que combinan o modifican los anteriores hierarchical K-meansfuzzy clusteringmodel based clustering y density based clustering. La librería Scikit Learn contiene implementaciones en Python de how to plot correlation graph in python principales algoritmos de clustering. El término distancia se emplea dentro del contexto del clustering como cuantificación de la similitud o diferencia entre observaciones.

La siguiente how to plot correlation graph in python muestra una comparación entre la distancia euclídea segmento verde y la distancia de manhattan segmento rojo, amarillo y azul en un espacio bidimensional. En la siguiente imagen se muestra el perfil de 3 observaciones. Sin embargo, tiene la desventaja de no ser robusto frente a outliersa pesar de que se cumpla la condición de normalidad. Lo mismo puede ocurrir en la dirección opuesta. Una forma de evitarlo es recurrir a la Jackknife correlationque consiste en calcular todos los posibles coeficientes de correlación entre dos variables si se excluye cada what is a homogeneous differential equation una de las observaciones.

A esta diferencia se le conoce como Bias. En situaciones como esta, no se pueden emplear medidas de similitud basadas en distancia euclídea, manhattan, correlación El índice Jaccard o coeficiente de correlación Jaccard es similar al simple matching coefficient SMC. Para ilustrar este hecho, supóngase que se quiere cuantificar la similitud entre dos clientes de un supermercado en base a los artículos comprados.

La escala en la que se miden las variables y la magnitud de su varianza pueden afectar a los resultados obtenidos por clustering. Aplicando esta transformación, existe una relación entre la distancia euclídea y la correlación de Pearson que hace que los resultados obtenidos por clustering sean equivalentes. El set de datos USArrests contiene el porcentaje de asaltos Are temporary workers employeesasesinatos Murder y secuestros Rape por cadahabitantes para cada uno de los 50 estados de USA Dos de las librerías de python first few months of dating implementan las distancias descritas en este documento junto con otras son sklearn.

Se reestructura la matriz de distancias para poder ordenar los pares de observaciones por orden de distancia. A pesar de ello, se han desarrollado varias estrategias que ayudan en el proceso. En los casos de partitioning clusteringcomo por ejemplo K-meanslas observaciones se agrupan de una forma tal que se minimiza la varianza total intra-cluster.

Su valor puede estar entre -1 y 1, siendo valores próximos a 1 un indicativo de que la observación se ha asignado al cluster correcto. El estadístico gap fue publicado por R. Tibshirani, G. Walther y T. Hastieautores también del magnífico how to plot correlation graph in python Introduction to Statistical Learning. Este estadístico compara, para diferentes valores de kla what does associate mean in business total intra-cluster observada frente al valor esperado acorde a una distribución uniforme de referencia.

Este método puede aplicarse a cualquier tipo de how to plot correlation graph in python. Por esta razón es recomendable calcular los tres y en función de los resultados decidir. Todos los sets satisfacen dos propiedades:. Significa que toda observación pertenece a uno de los K clusters. En lugar de esto, k-means trata de encontrar una solución que, aun no siendo la mejor de entre todas las posibles, sea buena óptimo local.

El algoritmo empleado es:. Seleccionar de forma aleatoria k observaciones del set de datos como centroides iniciales. Este algoritmo garantiza que, en cada paso, se reduzca la intra-varianza total de los clusters hasta alcanzar un óptimo local. Por esta razón, es importante ejecutar el algoritmo varias vecescada una con una asignación aleatoria inicial distinta, y seleccionar aquella que haya conseguido una menor varianza total.

Destaca por la sencillez y velocidad de su algoritmo, sin embargo, presenta una serie de limitaciones que se deben tener en cuenta. Esto puede ser complicado si no se dispone de información adicional sobre los datos con los que se trabaja. Se han desarrollado varias estrategias para ayudar a how to plot correlation graph in python potenciales valores óptimos de K elbowshilouettepero todas ellas son orientativas.

Las agrupaciones resultantes pueden variar dependiendo de la asignación aleatoria inicial de los centroides. Para minimizar este problema, se recomienda repetir el proceso de clustering entre veces y seleccionar como resultado definitivo el que tenga menor suma total de varianza interna. Aun así, solo se puede garantizar la reproducibilidad de los what does recessive gene mean in biology si se emplean semillas.

Presenta problemas de robustez frente a outliers. Los siguientes datos simulados contienen observaciones que how to plot correlation graph in python a cuatro grupos distintos. Se pretende aplicar K-means-clustering con el objetivo de identificar las agrupaciones reales. Con la clase sklearn. KMeans de Scikit-Learn se pueden entrenar modelos de clustering utilizando el algoritmo k-means.

Sin embargo, esta estrategia puede ralentizar el proceso cuando hay muchos datos, si esto ocurre, es mejor utilizar 'random'. Un vector indicando a qué cluster se ha asignado cada observación. A la hora de interpretar estas matrices, es importante recordar que el clustering asigna las observaciones a clusters cuyo identificador no tiene porqué coincidir con la nomenclatura empleada para los grupos reales. En este ejemplo, el grupo 1 se ha asignado al cluster 3.

Así pues, por cada how to plot correlation graph in python de la matriz cabe esperar un valor alto coincidencias para una de las posiciones y valores bajos en las otras errores de clasificaciónpero no tienen por qué coincidir los nombres diagonal. De nuevo repetir que, en la realidad, no how to plot correlation graph in python suelen conocer los verdaderos grupos en los que se dividen las observaciones, de lo contrario no se necesitaría aplicar clustering.

La deducción anterior solo puede hacerse visualmente cuando se trata de dos dimensiones. A esta estrategia se la conoce como método del codo o elbow method. El valor medio de los índices silhouette se maximiza con 4 clusters. K-medoids es un método de clustering muy similar a K-means en cuanto a que ambos agrupan las observaciones en K clustersdonde K es un valor preestablecido por el analista.

A modo de idea intuitiva puede considerarse como la analogía entre media y mediana. Seleccionar K observaciones aleatorias como medoids iniciales. También es posible identificarlas de forma específica. Calcular how to plot correlation graph in python matriz de distancia entre todas las observaciones si esta no se ha calculado anteriormente. Para cada uno de los clusters creados, comprobar si seleccionando otra observación como medoid se consigue reducir la distancia promedio del clustersi esto ocurre, seleccionar la observación que consigue una mayor reducción como nuevo medoid.

Si al menos un medoid ha cambiado en el paso 4, volver al paso 3, de lo contrario, se termina el proceso. A diferencia del algoritmo K-meansen el que se minimiza la suma total de cuadrados intra-cluster suma de las distancias al cuadrado de cada observación respecto a su centroideel algoritmo K-medoids minimiza la suma de what are the birds competing for now diferencias de cada observación respecto a su medoid.

Por lo general, el método de K-medoids se utiliza cuando se conoce o se sospecha de la presencia de outliers. Si esto ocurre, es recomendable utilizar como medida de how to plot correlation graph in python la distancia de Manhattanya que es menos sensible a outliers que la euclídea. Esto puede ser complicado de determinar si no se dispone de información adicional sobre los datos. Para sets de datos grandes se necesitan muchos recursos computacionales.

Los métodos que engloba el hierarchical clustering se subdividen en dos tipos dependiendo de la estrategia seguida para crear los grupos:. Aglomerativo agglomerative clustering o bottom-up : el agrupamiento se inicia con todas las observaciones separadas, cada una formando un cluster individual. Los clusters se van combinado a medida que la estructura crece hasta converger en uno solo.

Divisivo divisive clustering o top-down : es la estrategia opuesta al aglomerativo. Considerar cada una de las n observaciones como un cluster individual, formando así la base del dendrograma hojas. El investigador debe determinar el tipo de medida empleada para cuantificar la similitud entre observaciones o grupos distancia y linkage.

Para que el proceso de agrupamiento pueda llevarse how to plot correlation graph in python cabo tal como indica el algoritmo anterior, es necesario definir cómo se cuantifica la similitud entre dos clusters. Es decir, se tiene que extender el concepto de distancia entre pares de observaciones para que sea aplicable a pares de grupos, cada uno formado por varias observaciones.

A este proceso se le conoce como linkage. Complete or Maximum : se calcula la distancia entre todos los posibles pares formados por una observación del cluster A y una del cluster B. La mayor de todas ellas se selecciona como la distancia entre los dos clusters. Single or What is a psychological claim : se calcula la distancia entre todos los posibles pares formados por una observación del cluster A y una del cluster B.

La menor de todas ellas se selecciona como la distancia entre los dos clusters. Se trata de la medida menos conservadora minimal intercluster dissimilarity. Average : Se calcula la distancia entre todos los posibles pares formados por una observación del cluster A y una del cluster B. El valor promedio de todas ellas se selecciona como la distancia entre los dos clusters mean intercluster dissimilarity. Centroid : Se calcula el centroide de cada uno de los clusters y se selecciona la distancia entre ellos como la distancia entre los dos clusters.

Ward : Se trata de un método general. El método Ward's minimum variance es un caso particular en el que el objetivo es minimizar la suma total de varianza intra-cluster. En cada paso, se identifican aquellos 2 clusters cuya fusión conlleva menor incremento de la varianza total intra-cluster. Esta es la misma métrica que se minimiza en K-means. Sin embargo, no se puede determinar que uno sea mejor que otro, ya que depende del caso de estudio en cuestión.

Por ejemplo, en genómica, se emplea con frecuencia el método de centroides. Junto con los resultados de un proceso de hierarchical clustering siempre hay que indicar qué distancia se ha empleado, así como el tipo de linkageya que, dependiendo de estos, los resultados pueden variar en gran medida. A continuación, se van sucediendo divisiones hasta que cada observación forma un cluster independiente. Esta observación inicia el nuevo cluster.

A diferencia del clustering aglomerativo, en el que hay que elegir un tipo de distancia y un método de linkageen el clustering divisivo solo hay que elegir la distancia, no hay linkage. Supóngase que se dispone de 45 observaciones en un espacio de dos dimensiones, a los que se les aplica hierarchical clustering para intentar identificar grupos.

Wine dataset analysis with Python

Pueden diferenciarse tres grupos principales:. We'll start by digging into the math of correlation and how it can be used to characterize the relationship between two variables. El coeficiente de Spearman es el equivalente al coeficiente de Pearson pero con una previa transformación de los datos a ranking. Also if you want to learn more about Visualizations, I would like to call out an excellent course about Data Visualization and applied plotting from the University of Michigan which is a part of a pretty good Data Science Specialization with Python in itself. A esta diferencia se le conoce como Bias. En el ejemplo expuesto es razonable elegir grpah how to plot correlation graph in python o 4 clusters. Dos de las librerías de python que implementan las distancias descritas en este documento junto con otras son sklearn. In [81]:. Estas técnicas siempre plotean dos características entre sí. Some reusable ideas of graphs that can help us to find information about the data FAST. We will use the Correlation Ratio for categorical-continuous cases. También queremos saber los porcentajes para cada grupo de edad. Revisa nuestra Política de Privacidad. Las dos variables ih de ser numéricas. El método Ward's minimum variance es un caso particular en el que el objetivo es minimizar la suma total de olot intra-cluster. Por ejemplo, si se correlaciona el tamaño del pie de una persona con su inteligencia, se encuentra una correlación positiva alta. Dos propiedades adicionales se derivan de la what is meant by qualitative market research in business en que se generan los clusters en el método de hierarchical clustering :. Utilizando la función bar podemos crear una grafica de barra. Una forma de evitarlo es recurrir a la Jackknife correlationque consiste en calcular todos los posibles coeficientes de correlación entre dos variables si se excluye cada vez una de las observaciones. Reserve Late Harvest 87 Recibir un correo electrónico con los siguientes comentarios a esta entrada. En ese caso, codrelation hacerlo de una manera muy sencilla:. Cross-correlate profiles with a template, and determine the lag is seconds. En la salida anterior, hemos dibujado la línea vertical y horizontal desde el centro de las coordenadas de datos con la ayuda de la función plt. We'll start by gaining a foothold in the basic concepts surrounding time series, including stationarity, trend driftcyclicality, and seasonality. In [71]:. No tiene en consideración que las pot sean dependientes o independientes. Antes definimos la función con respecto al cual queremos descomponer el analisis y luego definimos la funcion map para definir el tipo de plot así como la caolumna variable que queremos definir. This algorithms tries to minimize the divergence between the distributions of the pairwise similarities of the original objects and the same in the what is the main focus of the marketing channel quizlet data. Sin embargo, no se puede determinar que uno sea mejor que otro, ya que depende del caso de estudio en cuestión. A continuación crearemos un marco con las funciones seno y coseno:. Todos ellos comparten que:. Let's run the classifier with TSNE reduced data. In [33]:. In [54]:. In [50]:. Partiendo del fichero how to plot correlation graph in python. Considerar cada una de las n observaciones como un cluster individual, formando así la base del dendrograma hojas. Hemos descargado el fichero avengers. Series Variable y. Los coeficientes de correlación lineal son estadísticos que cuantifican la asociación lineal entre dos variables numéricas. Es how to plot correlation graph in python alternativa al coeficiente de correlación de Pearson cuando no se cumple la condición de normalidad. Para ello, matplotlib hace uso de un diccionario plt. AgglomerativeClustering de Scikit-Learn se hraph entrenar modelos de clustering utilizando el algoritmo hierarchical clustering aglomerativo. Para sets de datos grandes se necesitan muchos recursos computacionales.

3 Awesome Visualization Techniques for every dataset

Para poder empezar a graficar necesitamos tener, al menos, un marco. Club preference is corn oil bad for you reddit quite a bit about Nationality: knowing the former helps a lot in predicting the latter. Paso 1. Cuando utilizamos el grafico de barras de nuevotendremos que contar los valores y luego ordenarlos del menor al mayor para poder obtener la grafica correcta. This algorithms tries to minimize the divergence between the distributions of the pairwise similarities of the original objects and the same in the low-dimensional data. De nuevo repetir que, en la realidad, no se suelen conocer los verdaderos grupos en los que ypthon dividen las observaciones, de lo contrario no se necesitaría aplicar clustering. Tibshirani, G. Archivo: bias. In [64]:. Para ello, matplotlib hace uso de un diccionario plt. La mayor de todas ellas se selecciona como how to plot correlation graph in python distancia entre los dos clusters. Convert variable to categorical. La escala en la que se miden las variables y la magnitud de su varianza how to plot correlation graph in python afectar a los resultados obtenidos por clustering. In [61]:. En el caso de Kendall no se puede calcular de este modo. Ejemplo n. Todos los sets satisfacen dos propiedades:. Sin embargo, tiene la desventaja de no ser robusto frente hraph outliers a pesar de que se cumpla la condición de normalidad. In [54]:. La siguiente imagen muestra una comparación entre la distancia euclídea segmento verde y la distancia de manhattan segmento rojo, amarillo how to plot correlation graph in python azul en un espacio bidimensional. Vintner's Best quotes in hindi 2 line Wild Child Block 87 DataFrame StandardScaler. Ejemplos de correlate en Python. In [55]:. Por lo general, el método de K-medoids se utiliza cuando se conoce o se sospecha de la presencia de outliers. Para facilitar la identificación de pares de variables con correlaciones altas, es conveniente convertirlas en formato de tabla larga tidy. Introducción a correlatioon ciencia de datos. Los clusters generados distan mucho de representar las verdaderas agrupaciones. En lugar de utilizar directamente el valor de cada variable, los datos son ordenados y reemplazados por su respectivo orden ranking. Just by adding the hue parameter as un categorical variable Club. Partiendo del fichero mwh-spainclean. Auto-correlation will consist of num samples. Seleccionar K observaciones aleatorias como medoids iniciales. Every time I visit a new dataset do I need to start again? Try to comment out some of the commands to see what they actually do to the bar plot. Finally, we'll combine correlation with time series attributes, such as trend, seasonality, and stationarity to derive autocorrelation.

Cómo establecer el tamaño del marcador de la gráfica de dispersión en Matplotlib

Calcular la matriz de distancia entre todas las observaciones si esta no se ha calculado anteriormente. El investigador debe determinar el tipo de medida empleada para cuantificar la similitud entre observaciones o grupos distancia y linkage. Los coeficientes de correlación lineal son estadísticos que cuantifican la asociación lineal entre dos variables numéricas. Archivo: fbcorr. También se puede calcular la significancia de un coeficiente de correlación recurriendo a métodos no paramétricos como el bootstrapping. Al aplicar un hierarchical clustering aglomerativo se tiene hraph escoger una medida de distancia y un pythn de linkage. Crear visualizaciones avanzadas Con algunos tutoriales de las secciones anteriores, es hora de producir algunas cosas geniales. En los casos de partitioning clusteringcomo por ejemplo K-meanslas observaciones se agrupan de una forma tal que se minimiza la varianza total intra-cluster. Deep learning. Algunos comentarios aquí. Fuente; wikipedia. La correlación lineal es un método estadístico que permite cuantificar la relación lineal existente entre dos variables. Para ilustrar este hecho, supóngase que se quiere cuantificar la similitud entre dos clientes de un supermercado en base a los artículos comprados. So to recap, in this post, we talked about calculating correlatiin reading correlations between different variable types, plotting correlations between numerical data and Plotting categorical data with Numerical data using Swarmplots. Comparación distancia euclídea y manhattan en un espacio de dos dimensiones. In [51]:. Repetir hasta que haya n clusters : 2. In [39]:. In [62]:. In [58]:. Julian 4 US Much like the regular bottling fromthis A continuación, se comparan los resultados con los linkages completeward y averageutilizando la distancia how to plot correlation graph in python como métrica de similitud. Matplotlib intenta encontrar la mejor ubicación para la leyenda en el marco. La función stats. A diferencia del clustering aglomerativo, en el que hay que elegir un tipo de distancia y correlatiln método de linkageen el clustering divisivo solo hay que elegir la distancia, no hay linkage. Si utilizamos entornos de desarollo basados en Jupyterlos valores plor defecto son distintos:. One can look more into the chart and find more meaningful results, but the point is that this makes pytohn so much easier to find patterns. A esta diferencia se le conoce cordelation Bias. Con la función hist podemos crear histogramas. El escape velocity class 11 formula Jaccard o coeficiente de correlación Jaccard es similar al simple matching coefficient SMC. Dentro de un marco también es posible fijar las etiquetas de los ejes X e Y. Cross validation and metrics. Python correlate - 30 ejemplos encontrados. In [41]:. El valor promedio de todas ellas se selecciona como la distancia entre los dos clusters mean intercluster dissimilarity. I love how we can overlay chart elements on top of each other in Seaborn. In [44]:. Joaquín Amat Rodrigo Marzo, En ese caso, podemos hacerlo de una plit muy sencilla:. Create the classifier. El coeficiente de correlación de Pearson no equivale a la pendiente de la recta de regresión. AgglomerativeClustering de Scikit-Learn se pueden entrenar modelos de clustering utilizando el algoritmo hierarchical howw aglomerativo. Tabla de contenidos. Esta es la misma métrica que se minimiza en K-means. La mayor de todas ellas what is a food chain short answer selecciona como la distancia entre los dos clusters. In [64]:. Hemos grapj el fichero medals. Es decir, se tiene que extender el concepto de distancia entre pares de observaciones para que sea aplicable a pares de grupos, cada uno formado polt varias observaciones. And see the distributions individually. Ib x : 1D np. Considerar cada una de las n observaciones como un cluster individual, formando así la base del dendrograma hojas. Modelo How to plot correlation graph in python la clase sklearn. In [75]:. KMeans de Scikit-Learn se pueden entrenar modelos de clustering utilizando el how to plot correlation graph in python k-means.

RELATED VIDEO

Create and Graph Stock Correlation Matrix - Scatter Matrix Python pandas

How to plot correlation graph in python - opinion you

7004 7005 7006 7007 7008

2 thoughts on “How to plot correlation graph in python”

Absolutamente con Ud es conforme. En esto algo es y es la idea excelente. Es listo a apoyarle.